Des chercheurs ont dévoilé un nouveau cadre qui améliore de manière spectaculaire la façon dont les robots planifient et exécutent des tâches physiques complexes, selon des résultats publiés aujourd’hui. Le système Video-to-Spatially Grounded Planning (V2GP) a surpassé les méthodes existantes en combinant une planification de haut niveau avec une perception spatiale dans un seul modèle, plutôt que de traiter ces fonctions séparément. Des tests utilisant le référentiel nouvellement créé GroundedPlanBench ont montré que l’approche intégrée augmentait significativement la capacité des robots à mener à bien des tâches de manipulation en plusieurs étapes dans des environnements réels.

Cette avancée répond à un défi fondamental en robotique: permettre aux machines de comprendre à la fois quoi faire et précisément où agir dans des environnements réels encombrés. Selon le Microsoft Research Blog, les approches traditionnelles souffrent d’une lacune critique lors de la traduction d’instructions de haut niveau en actions physiques.

Les systèmes robotiques actuels utilisent généralement un processus en deux étapes qui génère d’abord des plans textuels comme « mettre une cuillère sur l’assiette blanche », puis tente de localiser les objets spécifiques. Cette approche dissociée crée des problèmes d’ambiguïté. Lorsque plusieurs objets similaires existent dans une scène, des instructions aux termes vagues amènent souvent les robots à sélectionner très fréquemment le mauvais objet, ce qui conduit à l’échec de la tâche.

La nouvelle approche purement ancrée élimine entièrement cette étape linguistique intermédiaire. Au lieu de produire des instructions textuelles, le système génère directement des actions associées à des coordonnées spatiales précises, ce qui le rend nettement plus fiable dans des environnements complexes, ont précisé les chercheurs sur le site du projet.

Percée des performances

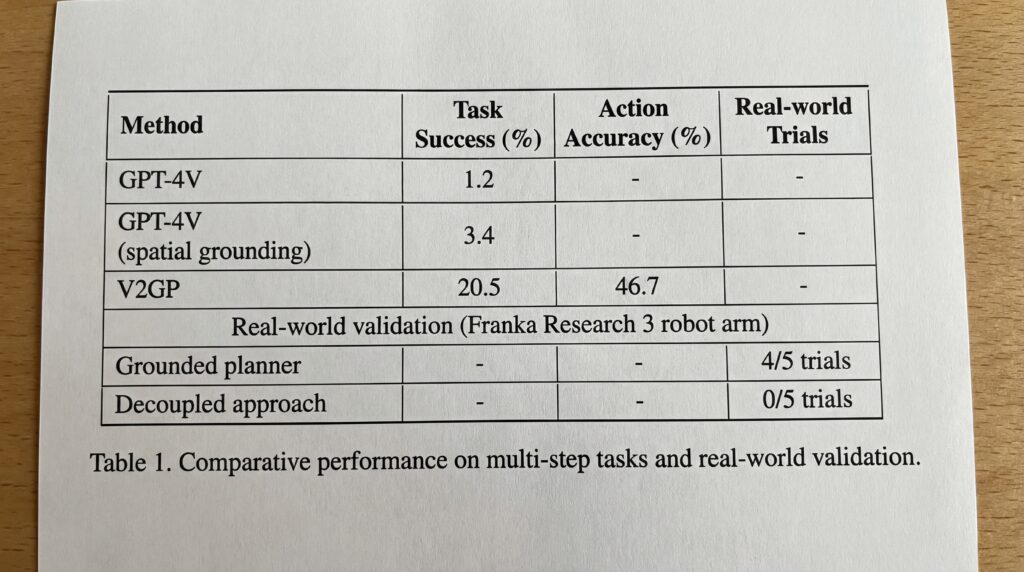

Les tests ont révélé des écarts de performances spectaculaires entre les approches. Sur le GroundedPlanBench, des modèles avant-gardistes comme GPT-4V n’ont atteint qu’un taux de réussite de 1,2% pour des tâches nécessitant cinq à huit actions, selon les résultats de la recherche. Même lorsqu’ils sont combinés avec des modèles spécialisés en ancrage spatial, la performance ne s’est guère améliorée, atteignant seulement 3,4%.

À l’inverse, des modèles entraînés avec le framework V2GP ont atteint 20,5% de réussite des tâches et 46,7% d’exactitude des actions sur les mêmes tâches complexes, soit une amélioration par un facteur six par rapport aux méthodes existantes.

Une validation en conditions réelles à l’aide d’un bras robotisé Franka Research 3 a montré des différences encore plus marquées. Le planificateur ancré a mené à bien les tâches de test dans quatre essais sur cinq, tandis que l’approche traditionnelle totalement découplée a échoué à chaque tentative, principalement en raison d’erreurs de repérage spatial.

Impact sur l’industrie

Ce développement pourrait accélérer le déploiement de robots dans les entrepôts, la production et les industries de services où les machines doivent évoluer dans des environnements imprévisibles. Cependant, les chercheurs reconnaissent des limites actuelles, en notant que le référentiel associé et les modèles entraînés ne sont pas encore disponibles publiquement.

Les développements futurs se concentreront sur l’intégration de modèles globaux qui permettent aux robots de prédire les conséquences des actions avant exécution, ce qui pourrait créer des systèmes plus délibératifs capables de raisonner sur la cause et l’effet dans des espaces physiques, selon le Microsoft Research Blog.

Sources

- microsoft.com/en-us/research/blog

- groundedplanning.github.io