Des chercheurs de Nature Machine Intelligence ont publié lundi une étude remettant en question la manière dont les systèmes de reconnaissance vocale par intelligence artificielle sont testés, arguant que les méthodes actuelles ne tiennent pas compte des multiples façons valides de transcrire la parole humaine. L’équipe, dirigée par Mona Sloane, propose de remplacer les tests d’exactitude à réponse unique traditionnels par un nouveau référentiel qui intègre les contributions de parties prenantes diverses (y compris des utilisateurs, des développeurs et des communautés concernées) afin d’évaluer plus justement si ces systèmes d’IA fonctionnent de manière équitable et efficace dans différents contextes.

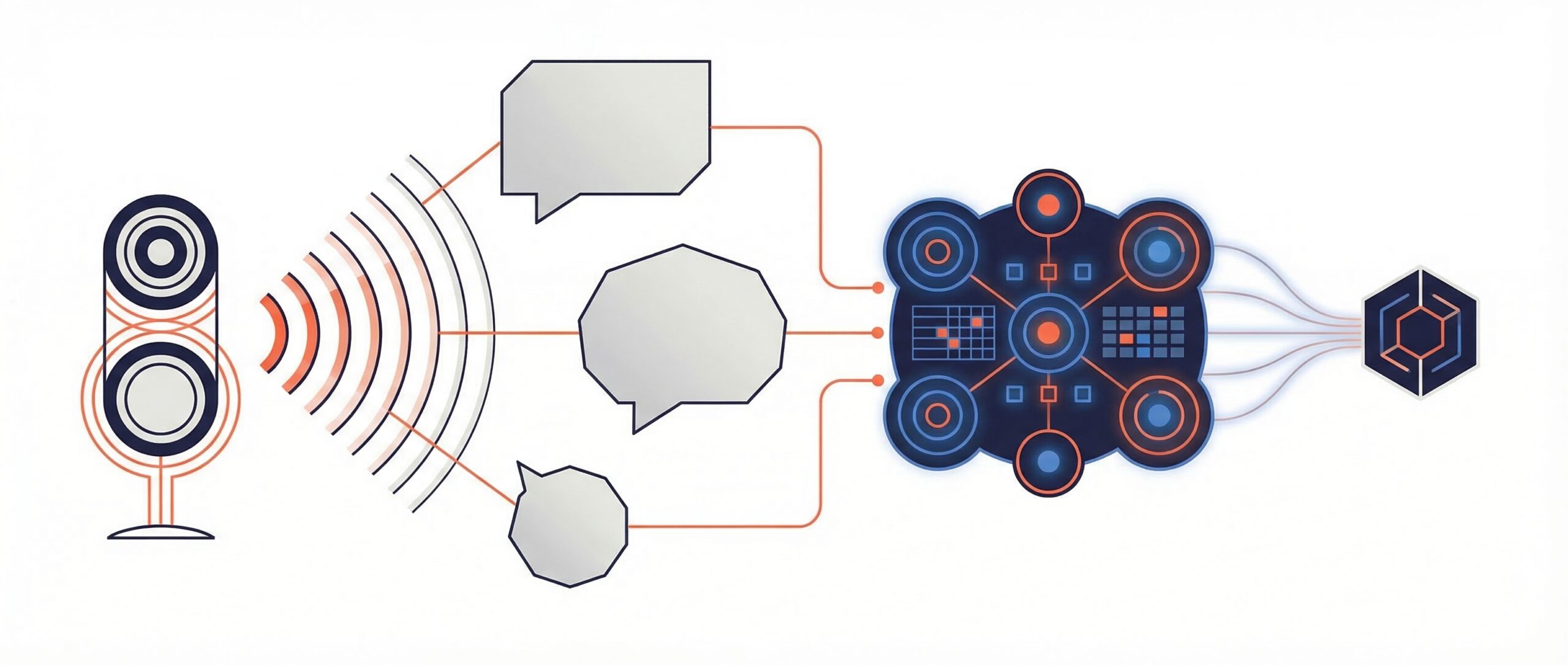

Le problème tient à la façon dont l’exactitude est mesurée. Les tests traditionnels de reconnaissance vocale (ASR) s’appuient sur des métriques comme le Word Error Rate (WER) et le Character Error Rate (CER), qui comparent les résultats du système à une unique transcription de référence. Mais selon les chercheurs, cette approche ignore une réalité fondamentale : il n’existe souvent pas une seule manière correcte de transcrire la parole humaine.

Imaginez une consultation médicale où un patient bégaie ou utilise des mots de remplissage comme « euh » et « hum ». Pour l’analyse clinique, préserver ces schémas de parole dans la transcription pourrait être crucial pour le diagnostic. En revanche, pour générer des résumés de réunion ou des sous-titres, une version nettoyée sans ces éléments serait plus appropriée. Les deux transcriptions sont valides, soutient l’étude, ce qui remet en cause la notion traditionnelle d’une « vérité terrain » objective unique.

Une nouvelle approche participative

L’équipe de recherche, dirigée par Mona Sloane, propose de passer de tests d’exactitude à référence unique à un cadre évaluatif participatif. Ce modèle rassemblerait des utilisateurs finaux, des développeurs, des experts du domaine et des communautés concernées pour déterminer collectivement ce qui constitue un résultat de reconnaissance vocale juste et utile selon les contextes spécifiques.

Plutôt que de simplement mesurer l’écart par rapport à une réponse correcte prédéfinie, cette approche faciliterait un dialogue structuré sur la performance et l’impact réels d’un système d’IA. Le référentiel privilégie la pertinence contextuelle plutôt que les scores d’exactitude bruts, ce qui pourrait conduire à des technologies de reconnaissance vocale plus équitables, mieux adaptées à des groupes d’utilisateurs divers.

Implications pour l’industrie

Les changements proposés pourraient avoir un impact significatif sur la manière dont les entreprises technologiques conçoivent et commercialisent des systèmes de reconnaissance vocale. Les standards actuels du secteur s’appuient fortement sur des métriques d’exactitude traditionnelles pour les comparaisons de produits et la conformité réglementaire. Une transition vers une évaluation participative exigerait de nouveaux référentiels et potentiellement des coûts de développement plus élevés.

Cependant, des détails essentiels quant à l’implémentation demeurent flous. L’article de Nature Machine Intelligence, publié le 16 mars 2026, n’a pas encore été rendu pleinement accessible, laissant sans réponse des questions sur les défis d’adoption pratique, les préoccupations de scalabilité et des recommandations de politiques spécifiques. L’équipe de recherche inclut les co-auteurs H. Schellmann et K.X. Mei, bien que les spécifications complètes de leur référentiel attendent encore une diffusion plus large.

À mesure que la reconnaissance vocale par IA s’intègre de plus en plus aux secteurs de la santé, de l’éducation et aux systèmes juridiques, cette remise en question des méthodes d’évaluation pourrait remodeler la façon dont ces technologies cruciales sont conçues, testées et déployées dans l’ensemble des industries.

Sources

- doi.org