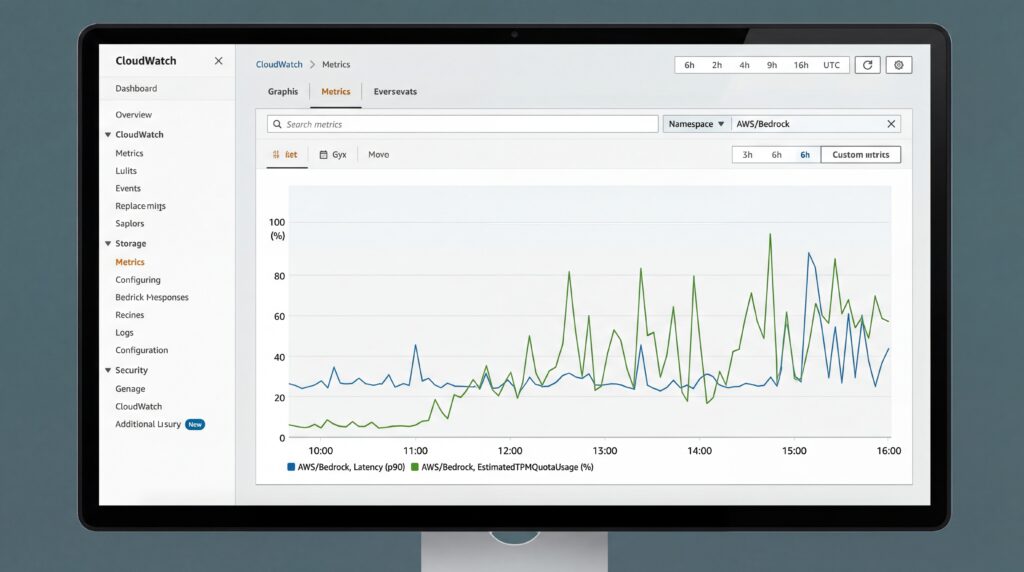

Amazon Web Services a lancé lundi deux nouveaux outils de supervision pour sa plateforme d’IA Bedrock, offrant aux développeurs une visibilité en temps réel sur les performances et l’utilisation des ressources de leurs applications d’IA générative. Les métriques CloudWatch (TimeToFirstToken et EstimatedTPMQuotaUsage) mesurent les temps de réponse des requêtes d’IA en streaming et suivent la consommation de jetons afin d’éviter les interruptions de service, ce qui permet aux équipes de concevoir des applications propulsées par l’IA plus fiables sans supervision côté client supplémentaire.

Ces nouvelles capacités arrivent alors que les entreprises sont de plus en plus confrontées à des goulots d’étranglement de performances et à des dépassements de coûts dans leurs déploiements d’IA, en particulier avec des modèles gourmands en ressources comme Claude d’Anthropic, qui applique un taux d’épuisement de 5x sur les jetons générés. Cela signifie que 100 jetons générés consomment en réalité 500 jetons du quota disponible, un calcul auparavant opaque pour les développeurs.

TimeToFirstToken mesure la latence côté serveur en millisecondes, depuis le moment où Bedrock reçoit une requête en streaming jusqu’à la génération du premier jeton de réponse, fournissant des signaux de performances bruts non altérés par les conditions réseau. Cette métrique fonctionne exclusivement avec les API de streaming, notamment ConverseStream et InvokeModelWithResponseStream.

EstimatedTPMQuotaUsage suit la manière dont les requêtes d’inférence consomment les quotas Jetons Par Minute, en tenant compte des multiplicateurs de consommation propres au modèle et d’autres facteurs internes. Le calcul varie selon le modèle d’allocation: le débit sur-demande additionne les jetons d’entrée, les écritures en cache et les jetons sortants multipliés, tandis que le débit provisionné applique des pondérations différentes aux opérations mises en cache.

Gestion proactive des performances

Selon l’AWS Machine Learning Blog, les métriques sont automatiquement émises dans le référentiel CloudWatch AWS/Bedrock pour toutes les requêtes d’inférence réussies, sans aucun coût supplémentaire au-delà de l’utilisation standard du modèle. Cette visibilité côté serveur élimine le besoin d’instrumentation côté client que de nombreuses équipes concevaient auparavant elles-mêmes.

Les équipes d’ingénierie peuvent désormais définir des Objectifs de Service et créer des alarmes automatisées. Pour les applications sensibles à la latence, elles peuvent configurer des alertes lorsque les temps de réponse au 90e centile dépassent 500 millisecondes. Les applications à haut débit peuvent déclencher des avertissements lorsque la consommation approche 80% du quota disponible, évitant ainsi les interruptions de service avant qu’elles ne surviennent.

Ces métriques s’intègrent avec des outils d’Infrastructure as Code comme CloudFormation et Terraform, permettant aux équipes de définir des stratégies de supervision de façon programmatique. Les signaux précoces d’EstimatedTPMQuotaUsage peuvent déclencher des disjoncteurs automatiques ou réduire les taux de requêtes avant que des erreurs de bridage n’affectent les utilisateurs.

Implications concurrentielles

Ce lancement positionne AWS de manière plus compétitive face à des rivaux comme Microsoft Azure et Google Cloud, qui proposent leurs propres solutions de supervision de plateformes d’IA. À mesure que l’IA générative passe de l’expérimentation aux déploiements en production, la visibilité opérationnelle devient cruciale pour l’adoption en entreprise.

Ce calendrier s’aligne avec la demande croissante des entreprises pour de meilleurs outils de gestion des coûts d’IA et d’optimisation des performances, en particulier à mesure que les sociétés étendent leurs implémentations d’IA générative au-delà des pilotes vers des applications essentielles à leur mission servant des millions d’utilisateurs.

Sources

- aws.amazon.com/blogs