Des chercheurs du MIT et de l’Université Polytechnique de Milan ont développé une nouvelle méthode d’intelligence artificielle qui explique automatiquement comment les modèles d’IA prennent leurs décisions, ce qui pourrait transformer des domaines sensibles comme le diagnostic médical. Le Mechanistic Concept Bottleneck Model (M-CBM) extrait et nomme les concepts que les systèmes d’IA utilisent réellement pour leurs prédictions, fournissant des explications plus précises et plus intelligibles que les approches précédentes basées sur des concepts définis par l’homme.

Cette percée répond à un défi majeur qui freine l’adoption de l’intelligence artificielle dans le domaine de la santé et d’autres secteurs sensibles : l’incapacité des systèmes d’IA à expliciter clairement leur raisonnement. Présentée à la International Conference on Learning Representations (ICLR) 2026, cette étude démontre comment le nouveau système peut identifier et nommer les caractéristiques visuelles spécifiques qu’il utilise lors du diagnostic de lésions cutanées ou de la classification d’espèces d’oiseaux, selon MIT News.

Dirigée par Antonio De Santis de l’Université Polytechnique de Milan et du Computer Science and Artificial Intelligence Laboratory (CSAIL) du MIT, l’équipe de recherche a développé une chaîne de traitement en quatre étapes qui change fondamentalement la manière dont les explications de l’IA fonctionnent. Plutôt que d’imposer aux modèles d’utiliser des concepts définis par l’homme qui peuvent ne pas bien correspondre à leur processus de prise de décision réel, le système extrait les concepts que l’IA a déjà identifiés comme pertinents.

Avancée technique

Le M-CBM utilise un autoencodeur parcimonieux pour analyser des modèles pré-entraînés et identifier leurs caractéristiques apprises les plus critiques. Un modèle linguistique multimodal génère ensuite automatiquement des descriptions en langage naturel pour chaque concept découvert, créant un pont direct entre les représentations internes complexes et la compréhension humaine. Le système se limite à n’utiliser que cinq concepts par prédiction, garantissant que les explications restent claires tout en préservant la précision.

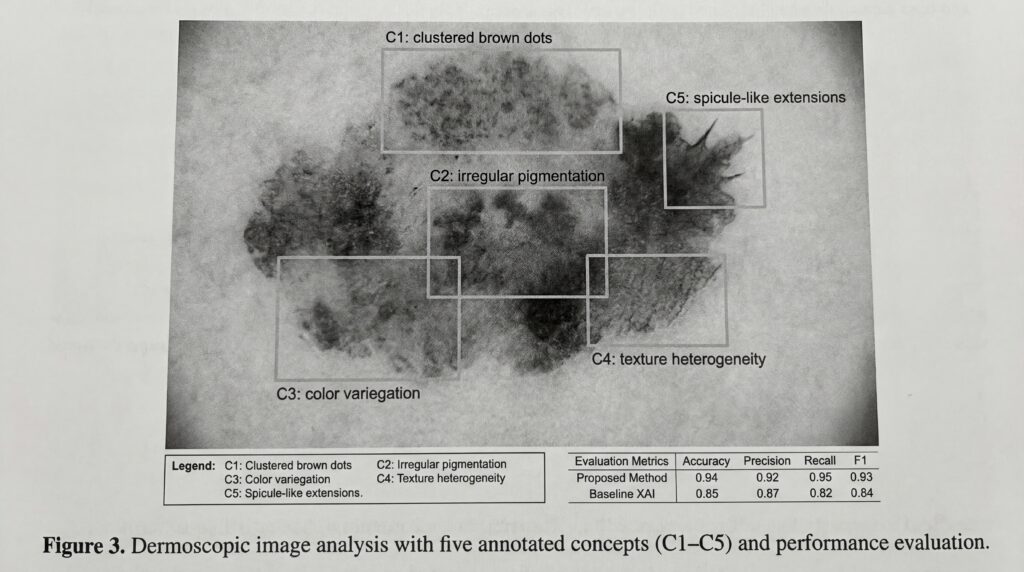

Lors des tests sur l’analyse d’images médicales et l’identification d’espèces, le M-CBM a atteint une précision plus élevée que les méthodes d’IA explicable existantes tout en fournissant des explications plus précises, selon le rapport de recherche. En analysant des lésions cutanées, par exemple, le système peut préciser qu’il a détecté des caractéristiques telles que des points bruns regroupés, permettant aux médecins d’évaluer s’il faut faire confiance à son diagnostic.

Impact sur le marché et limites

Malgré cette avancée, des défis importants subsistent. « Les modèles boîtes noires qui ne sont pas interprétables surpassent toujours les nôtres », a reconnu De Santis, soulignant le compromis persistant entre précision et interprétabilité. L’équipe a également signalé les risques potentiels de fuite d’informations, où les modèles pourraient « utiliser secrètement des concepts dont nous ignorons l’existence », pouvant nuire à la fiabilité des explications.

Les implications pour le déploiement de l’IA en santé sont considérables. Alors que la pression réglementaire augmente pour les systèmes d’IA transparents dans le milieu médical, des outils comme le M-CBM pourraient accélérer l’adoption en fournissant la traçabilité exigée par les cliniciens et les régulateurs. Les chercheurs prévoient de faire évoluer la méthode en utilisant des modèles de langage plus puissants afin de réduire encore l’écart de performance avec les systèmes non interprétables.

Sources

- news.mit.edu