Decoded©

-

Apache Flink : Definition, Struktur und Grenzen des Frameworks

Apache Flink wurde ursprünglich an der Technischen Universität Berlin entwickelt. Die ersten Versionen wurden 2011 veröffentlicht und sollten komplexe Probleme bei der Verarbeitung von Daten in einer verteilten Echtzeitumgebung lösen. Flink wurde im Laufe der Jahre zu einer Referenz für eine Vielzahl von Unternehmen, bis es schließlich zu einem der beliebtesten Open-Source-Frameworks wurde. Es war im Jahr 2014, als Flink als Apache Incubator-Projekt akzeptiert wurde, und 2015 wurde es zu einem Apache Top-Level-Projekt. Seitdem hat sich Flink stetig verbessert und ist stolz auf seine aktive Entwickler- und Nutzergemeinschaft.

Weiterlesen -

ONNX: Der offene Standard für portable KI-Modelle

Mit wachsender Komplexität der KI-Projekte gewinnt die Fähigkeit an Bedeutung, Modelle flexibel zu übertragen und in verschiedenen Umgebungen auszuführen. Das heutige Ökosystem umfasst zahlreiche Entwicklungsframeworks – jedes mit eigenen Besonderheiten und proprietären Formaten. ONNX (Open Neural Network Exchange) schafft hier Abhilfe: Als quelloffener Standard erleichtert es die Interoperabilität und verbindet die unterschiedlichen Systeme reibungslos.

Weiterlesen -

Mixture of Experts (MoE): Der revolutionäre KI-Ansatz, der die Zukunft prägt

Künstliche Intelligenz entwickelt sich rasend schnell, und groß angelegte Modelle wie ChatGPT oder Gemini erfordern leistungsstarke Infrastrukturen, um Milliarden von Parametern zu verarbeiten. Angesichts dieses enormen Bedarfs an Rechenleistung ist ein innovativer Ansatz erforderlich: das Mixture of Experts (MoE). Dieses Modell teilt die Aufgaben unter mehreren spezialisierten Experten auf und ermöglicht so die Optimierung der Rechenleistung und die Verbesserung der Leistung. In diesem Artikel werden wir die Funktionsweise des MoE, seine Vorteile, konkreten Anwendungen und Herausforderungen erforschen.

Weiterlesen -

Lead Data Scientist: Alles, was Du wissen solltest

Wenn Du nach Informationen über die Stelle des Lead Data Scientist suchst, wird Dir dieser Artikel eine große Hilfe sein. Dieser stellt nämlich die wichtigsten Funktionen, Aufgaben und Verantwortlichkeiten vor, die den Kern der täglichen Arbeit der meisten leitenden Wissenschaftler ausmachen.

Weiterlesen -

Manifold Learning: eine Schlüsseltechnik zur Reduzierung der Datengröße

Manifold Learning ist eine Technik, die die Visualisierung und Analyse komplexer, hochdimensionaler Datensätze vereinfacht, indem sie zugrunde liegende, niedrigdimensionale Strukturen in ihnen findet. Hier erfährst du alles, was du über diese unverzichtbare Methode des Machine Learning wissen musst!

Weiterlesen -

Data Strategist: Alles über diesen Datenberuf

Der Data Strategist ist ein Fachmann, der für die Entwicklung einer datenbasierten Strategie in einem Unternehmen verantwortlich ist. Hier erfährst du alles, was du über diese schnell wachsende Rolle wissen musst!

Weiterlesen -

Agentforce von Salesforce: Was ist es und wie funktioniert es?

Die CRM-Branche hat mit Agentforce das Tempo erhöht und bringt ChatGPT-ähnliche Fähigkeiten in den Bereich der Kundenbeziehungen. Geplant ist die Entwicklung spezialisierter Konversationsagenten, die in ihren Antworten die Geschäftspraktiken des Unternehmens integrieren…

Weiterlesen -

Oracle GoldenGate: Was ist es und wie funktioniert es?

Oracle GoldenGate ist Oracles Echtzeit-Datenreplikationslösung, die von dem amerikanischen IT-Riesen Oracle angeboten wird. Entdecke seine Funktionen, Architektur, Anwendungsfälle und die zahlreichen Vorteile, die es Unternehmen bietet!

Weiterlesen -

Krypto-KI-Agenten: Trading mit künstlicher Intelligenz

Einerseits gibt es den äußerst dynamischen Bereich der Kryptowährungen. Laut einigen wimmelt es dort nur so vor Gelegenheiten, die man im Vorbeigehen ergreifen kann. Andererseits steht uns die künstliche Intelligenz mit ihren Analysefähigkeiten rund um die Uhr zur Verfügung. Würden wir also das Beste aus beiden Welten vereinen, wenn wir diese beiden Bereiche in einem Krypto-KI-Agenten kombinieren?

Weiterlesen -

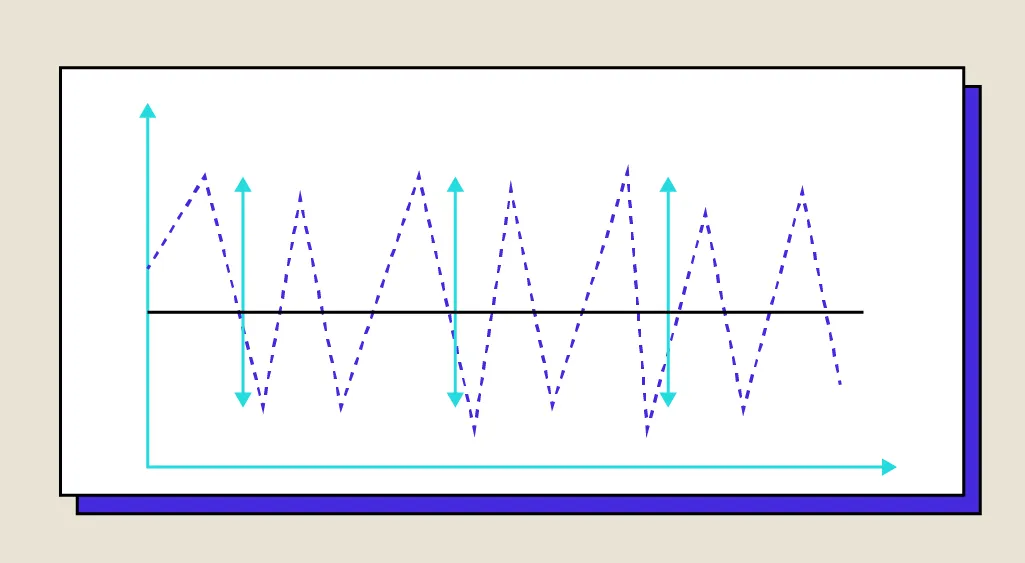

Zeitreihe Python: Verarbeitung und Modellierung

Eine Zeitreihe ist eine Datentabelle, die die Entwicklung einer Variablen im Laufe der Zeit wiedergibt. In Python wird die Zeitreihe oft in Form einer Pandas-Reihe verarbeitet, die durch ein DateTime indiziert ist. Dieses Format ist sehr einfach zu verarbeiten und zu visualisieren.

Weiterlesen -

GPU und Data Science: Wo ist der Zusammenhang?

Eine GPU oder „Graphics Processing Unit“ ist die Komponente eines Computers, die die Darstellung von Bildern auf dem Bildschirm ermöglicht. Es handelt sich dabei um die Grafikverarbeitungseinheit.

Weiterlesen -

Kibana: Das Tool zur Dat Visualisierung, die mit Elasticsearch indexiert sind

Das Backend ist nicht nur für die Webentwicklung, sondern auch für Data von entscheidender Bedeutung.

Weiterlesen

The newsletter of the future

Get a glimpse of the future straight to your inbox. Subscribe to discover tomorrow’s tech trends, exclusive tips, and offers just for our community.