Forschende haben in Nature Machine Intelligence am Montag eine Studie veröffentlicht, welche die Testverfahren für KI-basierte Spracherkennungssysteme in Frage stellt. Sie argumentieren, dass die gegenwärtigen Methoden den vielen legitimen Arten, gesprochene Sprache zu transkribieren, nicht Rechnung tragen. Das von Mona Sloane geleitete Team schlägt vor, herkömmliche Genauigkeitstests mit nur einer korrekten Antwort durch ein neues Framework zu ersetzen, das Feedback unterschiedlicher Stakeholder einbezieht, darunter Anwender, Entwickler und betroffene Gemeinschaften, um besser zu bewerten, ob diese KI-Systeme in verschiedenen Kontexten fair und effektiv funktionieren.

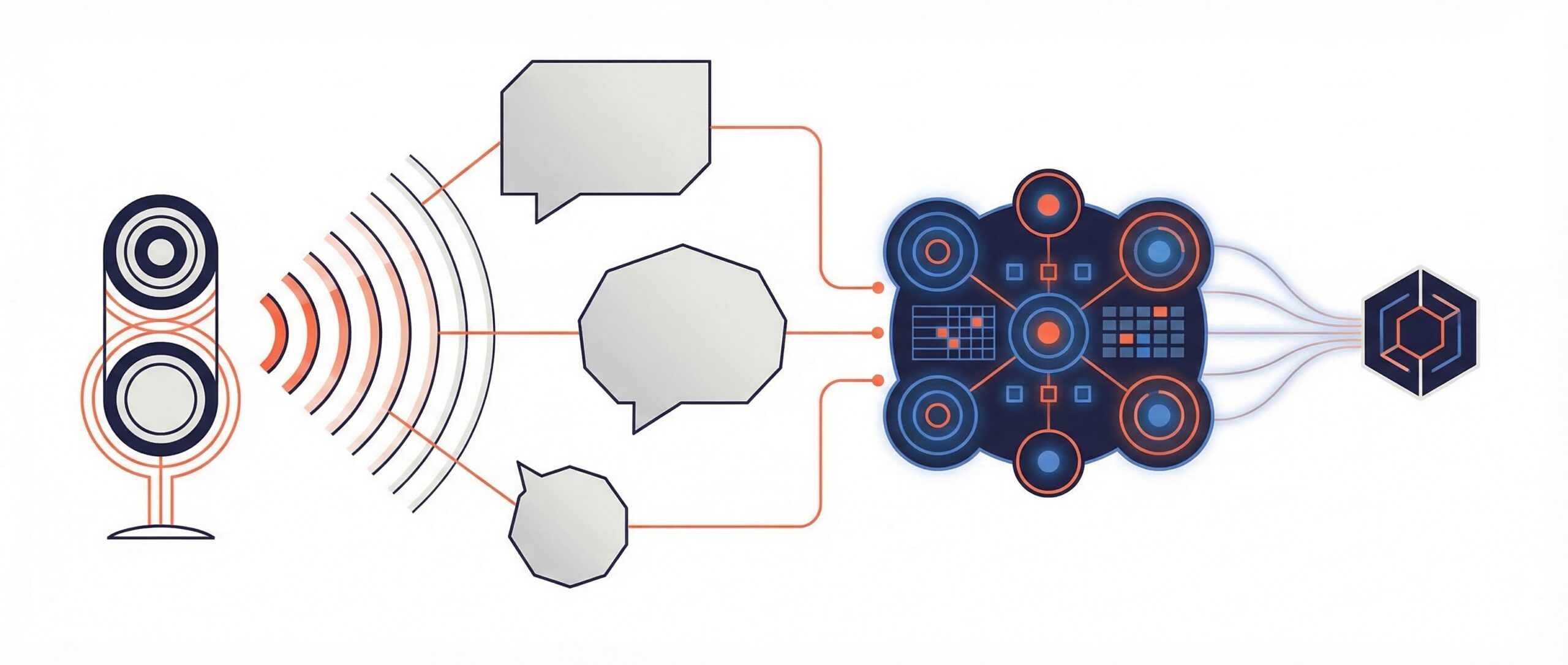

Das Kernproblem liegt in der Art, wie Genauigkeit gemessen wird. Herkömmliches Automatic Speech Recognition (ASR) Testing stützt sich auf Metriken wie Word Error Rate (WER) und Character Error Rate (CER), welche Systemausgaben mit einer einzigen Referenztranskription vergleichen. Nach Ansicht der Forschenden verkennt dieser Ansatz jedoch eine fundamentale Realität: Es gibt oftmals nicht nur eine einzige korrekte Art, menschliche Sprache zu transkribieren.

Stellen Sie sich eine medizinische Konsultation vor, in der eine Patientin oder ein Patient stottert oder Füllwörter wie „ähm“ und „äh“ verwendet. Bei der klinischen Analyse kann es für die Diagnose entscheidend sein, diese Sprechmuster in der Transkription beizubehalten. Für die Erstellung von Meeting-Zusammenfassungen oder Untertiteln wäre hingegen eine bereinigte Version ohne diese Elemente passender. Beide Transkriptionen sind legitim, so die Studie, was die herkömmliche Vorstellung einer einzigen objektiven „Ground Truth“ untergräbt.

Ein neuer stakeholder-zentrierter Ansatz

Das Forschungsteam unter Leitung von Mona Sloane schlägt vor, von Einzelreferenz-Genauigkeitstests zu einem stakeholder-zentrierten Auditing Framework überzugehen. Dieses Konzept würde Endnutzer, Entwickler, Fachexperten und betroffene Gemeinschaften zusammenbringen, um gemeinsam zu bestimmen, was in spezifischen Kontexten als faire und zweckmäßige Spracherkennungs-Ausgabe gilt.

Anstatt lediglich die Abweichung von einer vorab definierten korrekten Antwort zu messen, würde dieser Ansatz einen strukturierten Dialog über die tatsächliche Leistungsfähigkeit und Wirkung eines KI-Systems fördern. Das Framework priorisiert kontextuelle Angemessenheit gegenüber reinen Accuracy Scores und könnte so zu gerechteren Spracherkennungstechnologien führen, welche unterschiedlichen Nutzergruppen besser dienen.

Auswirkungen auf die Branche

Die vorgeschlagenen Änderungen könnten maßgeblich beeinflussen, wie Technologieunternehmen Spracherkennungssysteme entwickeln und vermarkten. Gegenwärtige Branchenstandards verlassen sich stark auf herkömmliche Genauigkeitsmetriken für Produktvergleiche und regulatorische Konformität. Ein Wechsel zu einer stakeholder-zentrierten Evaluierung würde neue Benchmarks und potenziell höhere Entwicklungskosten erfordern.

Dennoch bleiben entscheidende Details zur Umsetzung unklar. Der Beitrag in Nature Machine Intelligence, publiziert am 16. März 2026, ist noch nicht gänzlich zugänglich, sodass Fragen zu praktischen Einführungshürden, Skalierbarkeitsaspekten und konkreten Politikempfehlungen unbeantwortet bleiben. Zum Forschungsteam gehören die Co-Autorinnen und -Autoren H. Schellmann und K.X. Mei, doch die kompletten Framework-Spezifikationen stehen bislang aus.

Da KI-gestützte Spracherkennung zunehmend in Gesundheitssysteme, Bildungswesen und Rechtssysteme integriert wird, könnte dieses Umdenken bei den Bewertungsverfahren prägen, wie diese kritischen Technologien branchenübergreifend entwickelt, getestet und eingesetzt werden.

Sources

- doi.org