OpenAI hat am 17. März 2026 zwei neue KI-Modelle vorgestellt: GPT-5.4 mini und GPT-5.4 nano, entwickelt, um schnellere, günstigere KI-Systeme für Entwickler zu ermöglichen, die komplexe Multi-Agenten-Anwendungen bauen. Die Modelle bieten nahezu Flaggschiff-Leistung zu einem Bruchteil der Kosten, wobei der Preis für mini bei $0,75 pro Million Eingabe-Token liegt und für nano bei nur $0,20, was Konkurrenten wie Anthropics Claude und Googles Gemini direkt herausfordert.

Die neuen Modelle glänzen in spezialisierten Benchmarks, die für Entwickler besonders wichtig sind. Auf der SWE-bench Pro, die die Fähigkeit misst, reale GitHub-Issues zu lösen, erreicht GPT-5.4 mini 54,38 %, bemerkenswert nah an den rund 57,4 % des Flaggschiffs GPT-5.4, laut The New Stack. Während konkrete Werte für GPT-5.4 nano nicht offengelegt wurden, soll das Modell die Programmierfähigkeiten der Vorgängergeneration GPT-5 mini übertreffen.

Bei agentenbasierten Workloads, die Tool-Interaktionen erfordern, bleibt die Leistungslücke gering. GPT-5.4 mini erreicht 72,13 % im OSWorld-Verified Benchmark, der die Kompetenz beim Einsatz von Computer-Betriebssystemen zur Aufgabenbewältigung testet, verglichen mit den 75,03 % des Flaggschiffs. GPT-5.4 nano erzielt auf demselben Benchmark 39,01 % und positioniert sich damit für volumenstarke, leichtgewichtige Aufgaben wie Datenextraktion und Klassifikation statt für komplexe Computer-Navigation.

Geschwindigkeit trifft auf Erschwinglichkeit

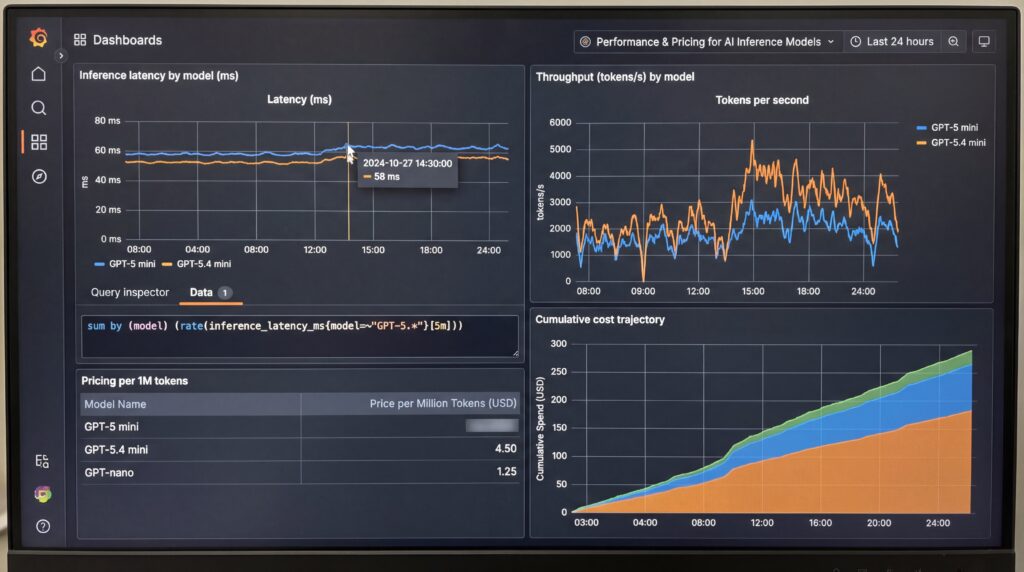

Abseits reiner Leistungsmetriken liegt die eigentliche Innovation der Modelle in ihren Geschwindigkeitssteigerungen. GPT-5.4 mini läuft mehr als doppelt so schnell wie das vorherige GPT-5 mini und behält dabei einen wettbewerbsfähigen Preis von $4,50 pro Million Ausgabe-Token bei. Die Nano-Variante, angeboten für $1,25 pro Million Ausgabe-Token, wurde laut The New Stack zum günstigsten OpenAI-Modell beim Start.

Diese Preisstruktur ermöglicht das, was Branchenbeobachter ein neues Paradigma in der KI-Entwicklung nennen. Entwickler können nun kostengünstig umfangreiche Rechenarbeit an diese kleineren Modelle delegieren, während teure Spitzenmodelle für High-Level-Planung und -Koordination reserviert bleiben. Dieser Ansatz macht anspruchsvolle KI-Systeme sowohl für Startups als auch für Unternehmen skalierbarer und wirtschaftlich tragfähiger.

Marktauswirkungen

Der Marktstart signalisiert einen breiteren Branchentrend hin zu Multi-Modell-Strategien. Statt sich auf einzelne, monolithische KI-Systeme zu stützen, werden fortgeschrittene Anwendungen zunehmend Gruppen spezialisierter Modelle nutzen. In dieser Architektur agiert das leistungsstärkste Modell als Agenten-Manager, während kleinere, schnellere Modelle wie mini und nano kleinteilige Aufgaben ausführen.

OpenAIs aggressive Preisgestaltung fordert Anthropics Claude 4.5 Haiku und Googles Gemini 3 Flash direkt heraus, beide zugeschnitten auf ähnliche, volumenstarke Use Cases. Die Modelle konkurrieren zudem mit effizienten Open-Source-Alternativen, darunter Varianten von Metas Llama, indem sie über verwaltete APIs überzeugende Leistung bieten.

Sources

- thenewstack.io