NVIDIA und Amazon Web Services haben Nemotron 3 Nano vorgestellt, ein KI-Modell mit 30 Milliarden Parametern, das jetzt über die serverlose Plattform Amazon Bedrock verfügbar ist. Das Small Language Model nutzt eine hybride Architektur, die Mamba- und Transformer-Technologien kombiniert, um unternehmensgerechte Coding- und Reasoning-Fähigkeiten bereitzustellen und zugleich die Rechenkosten für Unternehmen zu senken, die spezialisierte KI-Anwendungen entwickeln.

Die Veröffentlichung markiert eine bedeutende Ausweitung von NVIDIAs Präsenz im Markt für Cloud-AI-Services und baut auf der vorherigen Bereitstellung der Nemotron 2 Nano 9B- und 12B-Modelle bei AWS auf. Laut dem AWS Machine Learning Blog überzeugt das Modell in Branchen-Benchmarks wie SWE Bench Verified, AIME 2025 und Arena Hard v2 im Vergleich zu ähnlich großen Modellen.

Trotz insgesamt 30 Milliarden Parametern werden durch das Mixture-of-Experts-Design während des Betriebs nur 3,5 Milliarden Parameter aktiviert, was die Rechenanforderungen deutlich senkt. Das Modell unterstützt ein Context Window von bis zu 1 Million Tokens, allerdings können die Standardkonfigurationen je nach Speicherbeschränkungen variieren, so die Modelldokumentation von NVIDIA.

Marktpositionierung und Zugang für Unternehmen

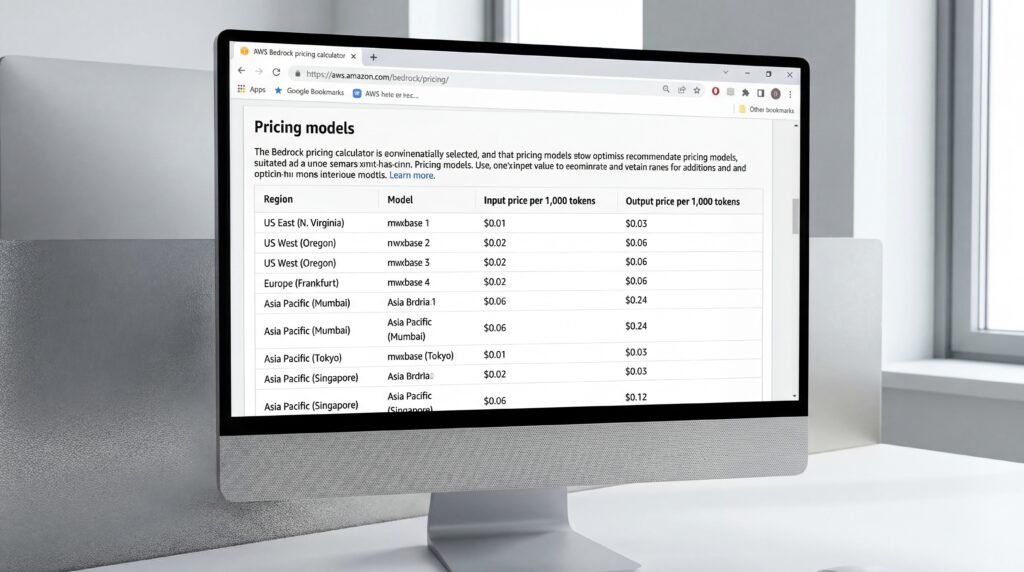

AWS hat das Modell in acht globalen Regionen bereitgestellt, darunter US East, US West, Asien-Pazifik, Südamerika und Europa. Die serverlose Implementierung eliminiert den betrieblichen Overhead und die MLOps-Investitionen, die beim Self-Hosting von GPU-Instanzen typischerweise erforderlich sind, erklärte AWS in der Ankündigung.

Die Preisgestaltung folgt einem Pay-per-Use-Modell; in der Region Asien-Pazifik Mumbai liegen die Kosten laut der Preisübersicht von Amazon Bedrock bei $0,06 pro 1.000 Input Tokens und $0,24 pro 1.000 Output Tokens. Damit positioniert sich Nemotron 3 Nano als kosteneffiziente Alternative zu konkurrierenden Modellen von Anthropic, Meta und Cohere, die auf der Plattform verfügbar sind.

Die AWS-Ankündigung verwies zur Untermauerung der Aussagen zu Genauigkeit und Effizienz auf Analysen von Artificial Analysis, einem unabhängigen Unternehmen. Das Modell richtet sich an Unternehmenskunden, die Agentic AI Systeme, Entwickler-Produktivitätstools und Retrieval Augmented Generation-Anwendungen zum Abfragen interner Wissensbasen entwickeln.

Lizenzierung und technische Implementierung

NVIDIA vertreibt Nemotron 3 Nano unter der Nemotron Open Model License und gewährt Nutzerinnen und Nutzern zeitlich unbegrenzte, weltweite, gebührenfreie Rechte zur Vervielfältigung, Verbreitung und Erstellung abgeleiteter Werke. Die Lizenz verpflichtet Weiterverteilende, Urheberrechtsvermerke beizubehalten, stellt das Modell jedoch „wie besehen“ ohne Gewährleistung bereit, so die Lizenzdokumentation von NVIDIA.

Entwicklerinnen und Entwickler können über die AWS SDKs mit dem Bezeichner nvidia.nemotron-nano-3-30b auf das Modell zugreifen. Das Modell arbeitet als reines Text-Sprachmodell, optimiert für Instruction-Following, Chatbots und gleichzeitige, leichte Workflows, die von KI Agent Clustern abgewickelt werden.

Sources

- aws.amazon.com/blogs/machine-learning

- nvidia.com