IBM hat heute sein Granite 4.0 1B Speech Modell vorgestellt, ein bahnbrechendes System mit einer Milliarde Parametern, das herausragende Spracherkennungsgenauigkeit liefert und auf Edge-Geräten ohne Cloud-Verbindung läuft. Das Open-Source-Modell, halb so groß wie sein Vorgänger, unterstützt sechs Sprachen mit Echtzeitübersetzung und belegte den ersten Platz auf dem OpenASR Leaderboard, wodurch Sprach-KI in Unternehmensqualität für ressourcenbeschränkte Umgebungen zugänglich wird.

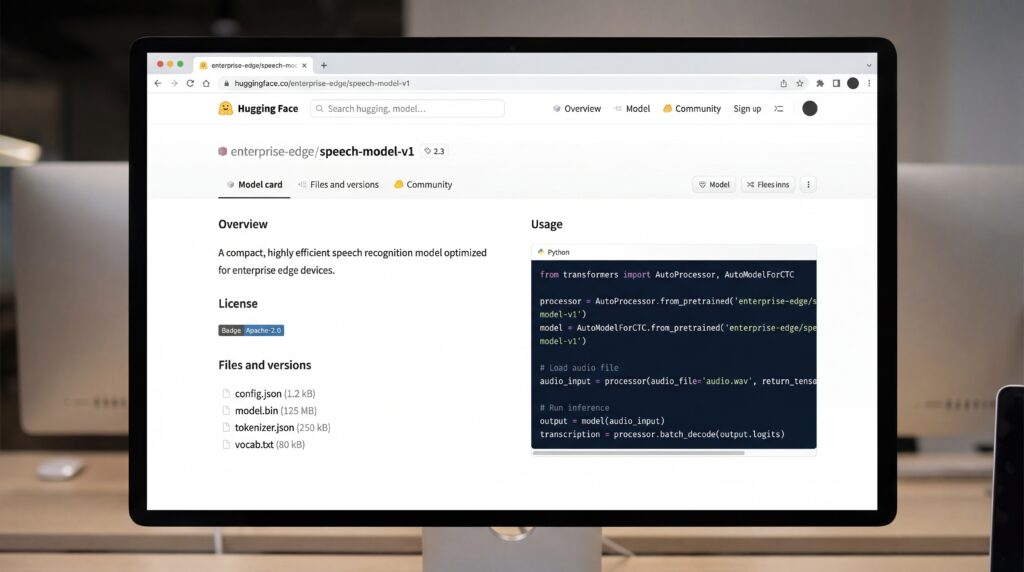

Die Architektur des Modells kombiniert einen Conformer-basierten Encoder mit einem Transformer-basierten Decoder und ermöglicht dadurch hohe Genauigkeit und effiziente Verarbeitung, laut der IBM-Ankündigung auf Hugging Face. Dieses hybride Design stellt eine beachtliche Ingenieursleistung dar und liefert überragende Leistung, obwohl es 50% kleiner ist als sein Vorgänger mit zwei Milliarden Parametern.

IBM hat das System mit mehr als einer Million Stunden Audiodaten trainiert, die mehrere Sprachen und Domänen abdecken. Das Training umfasste Pretraining auf diesem riesigen Datensatz, um allgemeine Speech Representations zu erlernen, gefolgt von Fine-Tuning für Automatic Speech Recognition und bidirektionale Speech Translation Tasks, wie das Unternehmen in seiner technischen Dokumentation ausführt.

Performance-Durchbruch

Das Modell erreichte unmittelbar nach Veröffentlichung das #1-Ranking auf dem OpenASR Leaderboard, gemessen an der Word Error Rate, bei der niedrigere Werte höhere Genauigkeit bedeuten. Laut IBMs Benchmarks übertrifft Granite 4.0 1B Speech viele größere Modelle und zeigt dabei eine höhere englische Transkriptionsgenauigkeit als sein Vorgänger.

Über reine Leistungsmetriken hinaus führt das System wichtige Enterprise-Features ein, darunter Keyword List Biasing, was die Erkennung spezifischer Begriffe wie Eigennamen und Akronyme verbessert. Diese Fähigkeit bewältigt eine langjährige Herausforderung bei unternehmensweiten Implementierungen, in denen spezialisiertes Fachvokabular essenziell ist, erklärt IBM in seiner Mitteilung.

Fokus auf Enterprise Edge Computing

Das Modell richtet sich explizit an „Enterprise-Anwendungen auf ressourcenbeschränkten Geräten“, laut IBMs Positionierung. Seine kompakte Größe reduziert den Speicherbedarf sowie Rechenanforderungen und unterstützt zugleich schnellere Inferenz durch Speculative Decoding sowie eine native Integration mit vLLM, einer High-Throughput Inference Engine.

Veröffentlicht unter der Apache 2.0 Lizenz erlaubt das Modell kommerzielle Nutzung, Modifikation sowie Verbreitung. IBM hat es auf dem Hugging Face Hub leicht zugänglich gemacht, inklusive dazugehörigen Modellgewichten und Nutzungsbeispielen für gängige Frameworks.

Die Fähigkeit des Systems, hochpräzise Sprachverarbeitung komplett lokal bereitzustellen, gewährleistet Datenschutz und Reaktionsfähigkeit in Echtzeit ohne Cloud-Konnektivität und positioniert es als überzeugende Alternative für Organisationen mit Anforderungen an Datensicherheit, Kosten oder Konnektivität. Für produktive Einsätze mit erhöhten Sicherheitsanforderungen empfiehlt IBM, das Modell mit seinem Granite Guardian-Tool zu kombinieren.

Auch wenn IBM keine spezifische Roadmap für die Granite Speech Collection präsentiert hat, fördert das Unternehmen aktiv Community-Feedback, um die zukünftige Entwicklung zu steuern, was einen offenen Ansatz zur Weiterentwicklung von Enterprise Voice AI signalisiert.

Sources

- https://huggingface.co/blog