Forscher des MIT und der Polytechnischen Universität Mailand haben eine neue Methode der Künstlichen Intelligenz entwickelt, welche automatisch erklärt, wie KI-Modelle Entscheidungen treffen, was potenziell Hochrisikobereiche wie die medizinische Diagnostik transformieren könnte. Das Mechanistic Concept Bottleneck Model (M-CBM) extrahiert und benennt die Konzepte, welche KI-Systeme tatsächlich für Vorhersagen nutzen, und erzeugt präzisere und verständlichere Erklärungen als frühere Ansätze, die auf von Menschen definierten Konzepten basierten.

Der Durchbruch löst eine kritische Herausforderung, welche die Einführung von künstlicher Intelligenz im Gesundheitswesen und anderen sensiblen Sektoren behindert hat: die Unfähigkeit von KI-Systemen, ihr Denken klar zu artikulieren. Laut MIT News zeigt die auf der International Conference on Learning Representations (ICLR) 2026 veröffentlichte Forschung, wie das neue System jene spezifischen visuellen Merkmale identifizieren und benennen kann, die es bei der Diagnose von Hautläsionen oder der Klassifizierung von Vogelarten verwendet.

Unter der Leitung von Antonio De Santis von der Polytechnischen Universität Mailand und MITs Computer Science and Artificial Intelligence Laboratory (CSAIL) entwickelte das Forschungsteam eine Vier-Stufen-Pipeline, welche die Funktionsweise von KI-Erklärungen grundlegend verändert. Anstatt Modelle dazu zu zwingen, von Menschen definierte Konzepte zu verwenden, welche möglicherweise nicht mit deren tatsächlichem Entscheidungsprozess übereinstimmen, extrahiert das System Konzepte, welche die KI bereits als relevant erlernt hat.

Technischer Durchbruch

Der M-CBM verwendet einen Sparse Autoencoder, um vortrainierte Modelle zu analysieren und deren kritischste gelernte Merkmale zu identifizieren. Ein multimodales Language Model erzeugt dann automatisch natürlichsprachliche Beschreibungen für jedes entdeckte Konzept und schafft eine direkte Brücke zwischen komplexen internen Repräsentationen und menschlichem Verständnis. Das System beschränkt sich darauf, pro Vorhersage nur fünf Konzepte zu verwenden, um sicherzustellen, dass Erklärungen leichtverständlich bleiben, während die Genauigkeit erhalten bleibt.

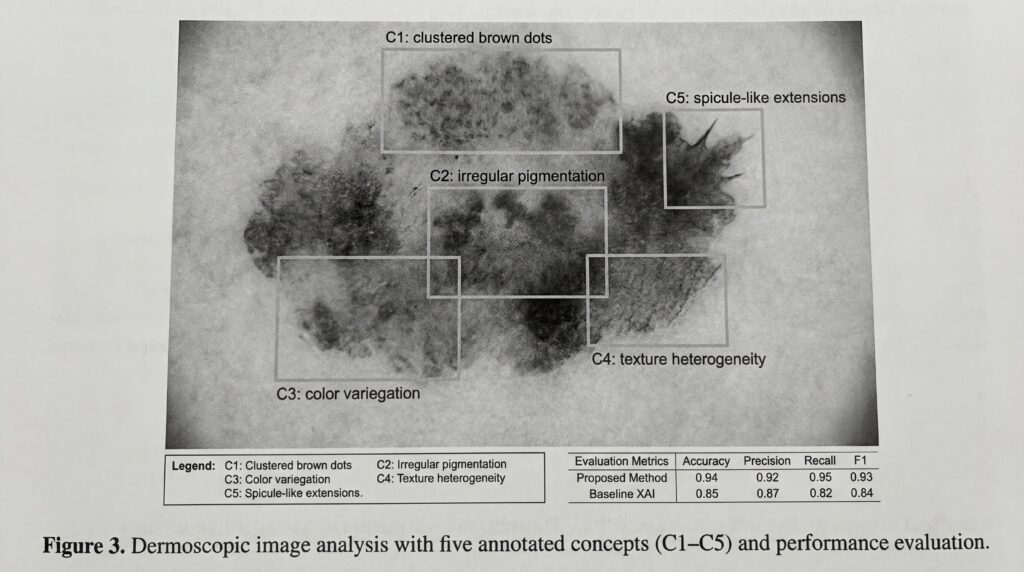

Bei Tests in der medizinischen Bildanalyse und der Artenbestimmung erreichte der M-CBM eine höhere Genauigkeit als bestehende erklärbare KI-Methoden, während er gleichzeitig präzisere Erklärungen lieferte, so das Forschungspapier. Bei der Analyse von Hautläsionen kann das System beispielsweise angeben, dass es Merkmale wie „gruppierte braune Punkte“ erkannt hat, sodass Ärzte einschätzen können, ob sie der Diagnose vertrauen sollten.

Marktwirkung und Einschränkungen

Trotz des Fortschritts bleiben bedeutende Herausforderungen bestehen. „Black-Box-Modelle, die nicht interpretierbar sind, übertreffen uns weiterhin,“ gestand De Santis und hob den anhaltenden Zielkonflikt zwischen Genauigkeit und Interpretierbarkeit hervor. Das Team warnte außerdem vor möglicher Informationsleckage, bei der Modelle eventuell „heimlich Konzepte anwenden könnten, von denen wir nichts wissen“, was die Zuverlässigkeit der Erklärungen potenziell untergräbt.

Die Auswirkungen für den Einsatz von KI im Gesundheitswesen sind erheblich. Da der regulatorische Druck für transparente KI-Systeme in medizinischen Umgebungen zunimmt, könnten Werkzeuge wie M-CBM die Einführung beschleunigen, indem sie jene Nachvollziehbarkeit bieten, welche Kliniker und Aufsichtsbehörden verlangen. Die Forscher planen, die Methode mit leistungsstärkeren Sprachmodellen zu skalieren, um die Leistungsdifferenz gegenüber nicht interpretierbaren Systemen weiter zu verringern.

Sources

- news.mit.edu