Databricks gab am 13. März 2026 die allgemeine Verfügbarkeit von Serverless Workspaces für Microsoft Azure bekannt und erspart damit den Kunden die Notwendigkeit, Cloud-Infrastruktur zur Ausführung von Data Analytics und AI Workloads zu verwalten. Das neue Bereitstellungsmodell, das in mehreren Azure-Regionen verfügbar ist, ermöglicht es Organisationen, Databricks-Umgebungen in Sekundenschnelle mit automatischer Skalierung und Abrechnung im Sekundentakt zu erstellen, erfordert jedoch Unity Catalog und bietet keine vom Kunden verwalteten Netzwerkoptionen.

Das neue Bereitstellungsmodell stellt einen grundlegenden Wandel dar, wie Unternehmen Dateninfrastruktur handhaben, indem Compute-Ressourcen von kundenseitig verwalteten Azure Virtual Networks in eine von Databricks verwaltete Multi-Tenant-Umgebung verlagert werden. Laut dem Databricks Blog beseitigt diese architektonische Änderung die Notwendigkeit, VNets zu konfigurieren, IP-Bereiche zuzuweisen oder Firewall-Regeln und NAT-Gateways zu verwalten.

Das Serverless-Angebot unterstützt alle wichtigen Databricks Workloads, darunter Notebooks, Workflows, Databricks SQL, Delta Live Tables und Model Serving, allesamt angetrieben von der leistungsstarken Photon Engine. Der Dienst startete in 12 Azure-Regionen, darunter Australia East, Canada Central, Central US, East US, East US 2, France Central, Germany West Central, North Europe, UK South, West Europe, West US und West US 3.

Preisstruktur und Kostenauswirkungen

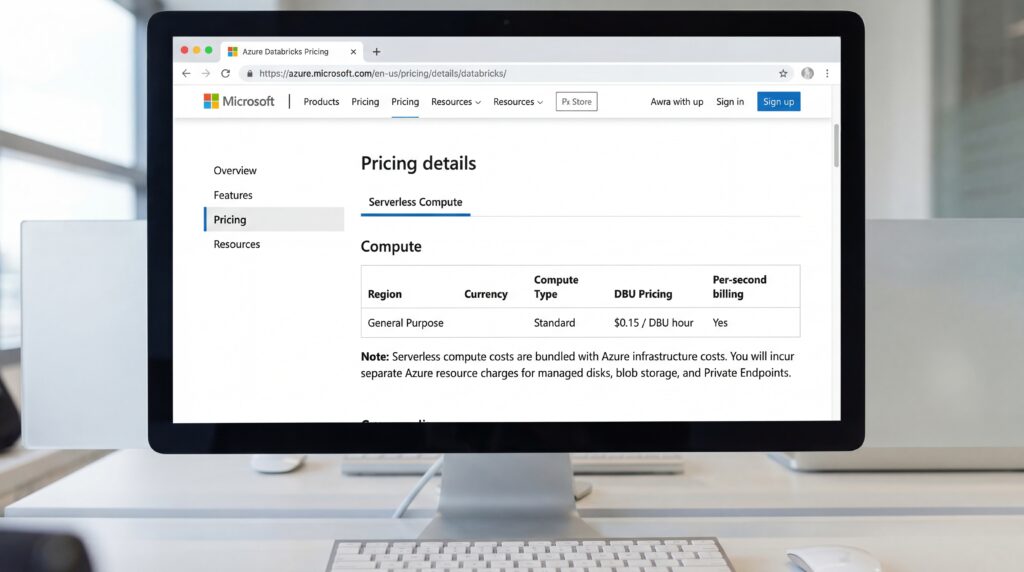

Das wirtschaftliche Modell unterscheidet sich deutlich von herkömmlich bereitgestellten Clustern. Organisationen zahlen einen höheren Databricks Compute Unit (DBU) Tarif, der die zugrunde liegenden Azure-Infrastrukturkosten abdeckt und gemäß der Azure Databricks Pricing Dokumentation separate VM-Gebühren überflüssig macht. Die Abrechnung im Sekundentakt stellt sicher, dass Unternehmen nur für aktive Compute-Zeit zahlen, was bei intermittierenden Workloads potenziell erhebliche Einsparungen ermöglicht.

Die Microsoft Learn Dokumentation weist darauf hin, dass Compute-Kosten zwar gebündelt werden, Kunden jedoch weiterhin für zugehörige Azure-Ressourcen wie Managed Disks, Blob Storage und Netzwerkkomponenten wie Private Endpoints verantwortlich bleiben. Für Workloads mit variabler oder sprunghafter Nachfrage dürfte das Serverless-Modell kostengünstiger ausfallen, als ungenutzte Cluster vorzuhalten.

Technische Einschränkungen und Migrationsherausforderungen

Trotz ihrer Vorteile bringt die Serverless-Architektur nennenswerte Einschränkungen mit sich. Organisationen können keine spezifischen VM-Instanztypen auswählen, da Databricks die Ressourcenallokation automatisch steuert. Die Pflicht zu Unity Catalog bedeutet, dass Unternehmen das Governance-Framework von Databricks übernehmen müssen, bevor sie auf Serverless-Funktionen zugreifen können.

Entscheidend ist, dass es keinen direkten Upgrade-Pfad von Classic zu Serverless Workspaces gibt. Laut Databricks-Dokumentation müssen Organisationen Ressourcen in neue Serverless-Umgebungen neu bereitstellen, wobei Unity Catalog jedoch einheitlichen Datenzugriff über beide Modelle hinweg gewährleistet. Das Fehlen einer kundenseitig verwaltbaren VNet Injection bedeutet, dass Unternehmen, die spezifische Firewall-Regeln oder On-Premises-Verbindungen benötigen, für diese Workloads Classic Workspaces beibehalten müssen.

Die Veröffentlichung positioniert Databricks für einen wettbewerbsstärkeren Auftritt im Markt für Cloud Data Platforms, in dem vereinfachtes Management und nutzungsbasierte Preisgestaltung zu zentralen Differenzierungsmerkmalen geworden sind. Für Data Teams, die mit Infrastruktur-Overhead kämpfen, verspricht das Serverless-Modell eine beschleunigte Time-to-Value bei gleichzeitiger Gewährleistung der Sicherheit auf Enterprise-Niveau durch Azure Active Directory Integration und die rollenbasierten Zugriffskontrollen des Unity Catalog.

Sources

- databricks.com/blog

- azure.microsoft.com

- learn.microsoft.com