Investigadores de Yale e IBM han presentado un nuevo marco para descifrar qué es lo que los modelos de inteligencia artificial realmente «comprenden» sobre el mundo, según un estudio publicado en Nature Machine Intelligence. El enfoque, desarrollado por Jonathan Warrell y sus colegas, aplica principios de la filosofía de la ciencia para analizar de forma sistemática cómo los sistemas de IA crean representaciones internas de conceptos del mundo real, un paso crítico para dotar a estas tecnologías poderosas pero opacas de mayor interpretabilidad.

El avance llega en un momento en que los sistemas de IA influyen cada vez más en decisiones críticas en medicina y atención sanitaria, donde comprender cómo los modelos llegan a sus conclusiones puede ser una cuestión de vida o muerte. El equipo, liderado por Jonathan Warrell de NEC Laboratories America y Universidad Yale, junto con los coautores principales Michael Gancz de Universidad Stanford y Hussein Mohsen de la Universidad de Toronto, desarrolló lo que llaman un marco de «semántica modelística».

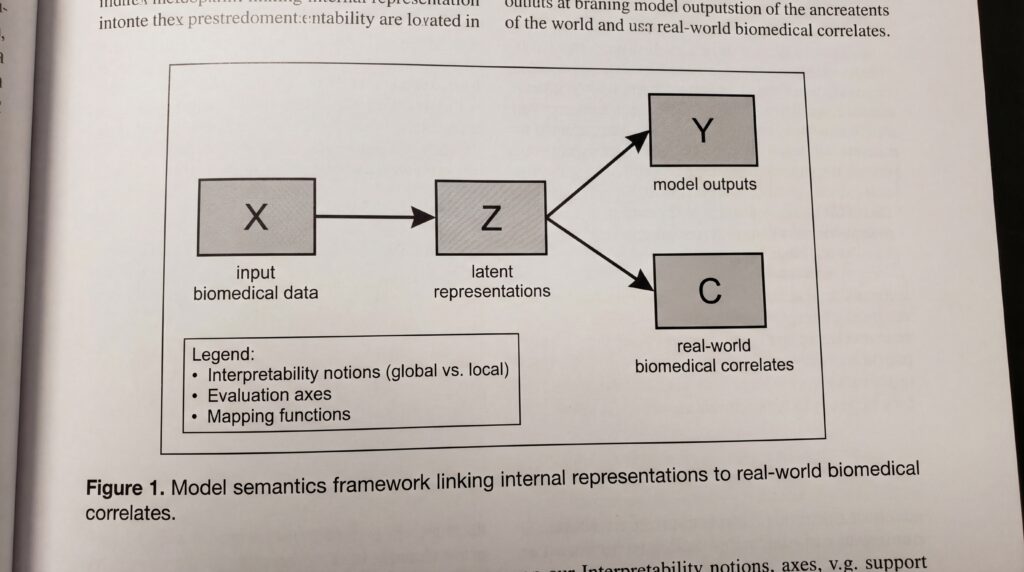

A diferencia de los métodos interpretativos existentes que se centran en técnicas individuales, este marco proporciona una estructura integral para analizar cómo los modelos de IA se relacionan con fenómenos del mundo real. Adapta conceptos formales de la filosofía de la ciencia para evaluar de manera sistemática qué han aprendido realmente los sistemas de aprendizaje profundo a partir de sus datos formativos.

«El marco va más allá de los métodos interpretativos actuales al tratarlos como solo un componente de la estructura semántica global de un modelo», según el estudio publicado en Nature Machine Intelligence. El enfoque descompone el concepto de interpretabilidad en componentes semánticos definidos formalmente, lo que permite a los investigadores comprender mejor los significados implícitos dentro de los sistemas de IA.

Desentrañando la caja negra

El marco de semántica modelística aborda un desafío fundamental en inteligencia artificial: determinar qué es lo que las redes neuronales realmente «saben» sobre el mundo que modelan. En biomedicina, donde la IA ayuda cada vez más en el diagnóstico, el descubrimiento de fármacos y la planificación de tratamientos, esta comprensión es crucial para garantizar la seguridad y la fiabilidad.

El equipo de investigación, que también incluye a Prashant Emani y Mark Gerstein de los departamentos de Yale de Biofísica Molecular y Bioquímica, Ciencias Computacionales y Estadística y Data Science, enfatiza que su objetivo no es crear nuevos métodos interpretativos sino proporcionar una estructura formal para analizar los existentes.

Al apoyarse en la filosofía de la ciencia, donde semántica modelística se refiere a cómo los modelos científicos representan fenómenos del mundo real, el marco ofrece una manera sistemática de descubrir y evaluar los correlatos del mundo real de las representaciones internas de un modelo. Esta base teórica podría resultar particularmente valiosa en aplicaciones biomédicas, donde comprender las decisiones del modelo puede impactar directamente la atención al paciente.

La publicación representa un avance teórico significativo para hacer que la IA sea más transparente y confiable, aunque las implicaciones prácticas completas para las aplicaciones biomédicas requieren un análisis detallado adicional a medida que la metodología completa esté disponible para la comunidad investigadora en general.

Sources

- doi.org