NVIDIA y Amazon Web Services lanzaron Nemotron 3 Nano, un modelo de IA con 30 mil millones de parámetros ahora disponible a través de la plataforma serverless de Amazon Bedrock. El small language model emplea una arquitectura híbrida que combina tecnologías Mamba y Transformer para ofrecer capacidades de programación y razonamiento a nivel empresarial, al tiempo que reduce los costos computacionales para empresas que desarrollan aplicaciones de IA especializadas.

El lanzamiento marca una expansión significativa de la presencia de NVIDIA en el mercado de servicios de IA en la nube, sobre la base del despliegue previo de los modelos Nemotron 2 Nano 9B y 12B en AWS. Según el AWS Machine Learning Blog, el modelo sobresale en benchmarks de la industria como SWE Bench Verified, AIME 2025 y Arena Hard v2 en comparación con modelos de tamaño similar.

A pesar de contener 30 mil millones de parámetros totales, el modelo activa solo 3.5 mil millones de parámetros durante su funcionamiento mediante su diseño Mixture-of-Experts, lo que reduce drásticamente los requisitos computacionales. El modelo admite un context window de hasta 1 millón de tokens, aunque las configuraciones predeterminadas pueden variar según las limitaciones de memoria, de acuerdo con la documentación del modelo de NVIDIA.

Posicionamiento en el mercado y acceso empresarial

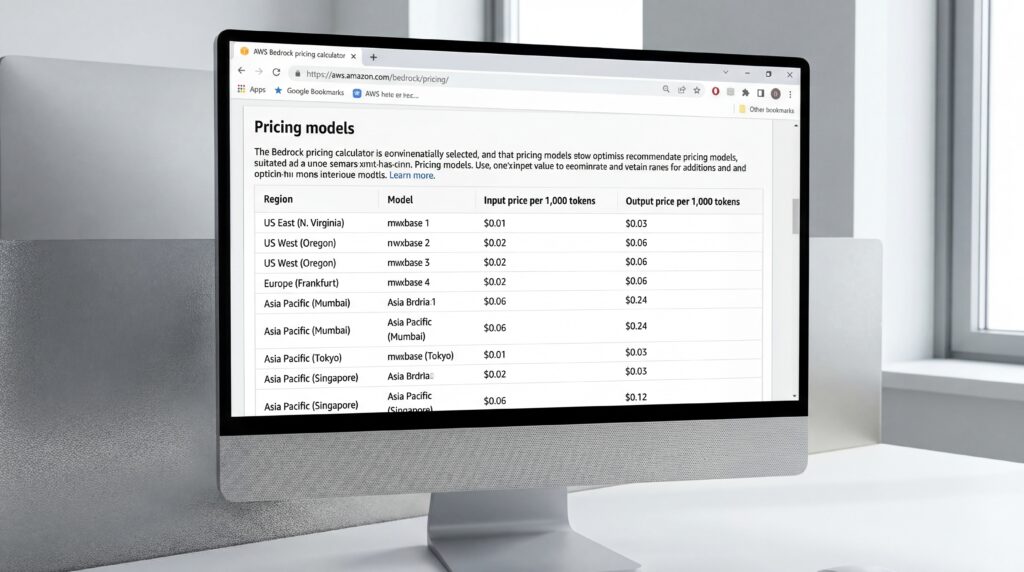

AWS ha implementado el modelo en ocho regiones globales, incluidas US East, US West, Asia Pacific, Sudamérica y Europa. La implementación serverless elimina la sobrecarga operativa y la inversión en MLOps que normalmente se requieren para autoalojar instancias GPU, indicó AWS en su anuncio.

El precio sigue un modelo de pago por uso, con tarifas en la región Asia Pacific Mumbai de $0.06 por 1,000 tokens de entrada y $0.24 por 1,000 tokens de salida, según la página de precios de Amazon Bedrock. Esto posiciona a Nemotron 3 Nano como una alternativa rentable frente a modelos competidores de Anthropic, Meta y Cohere disponibles en la plataforma.

El anuncio de AWS citó análisis de Artificial Analysis, una firma independiente, para validar las afirmaciones de precisión y eficiencia del modelo. El modelo está dirigido a clientes empresariales que desarrollan agentic AI systems, herramientas de productividad para desarrolladores y aplicaciones de Retrieval Augmented Generation para consultar bases de conocimiento internas.

Licenciamiento e implementación técnica

NVIDIA distribuye Nemotron 3 Nano bajo su Nemotron Open Model License, que otorga a los usuarios derechos perpetuos, globales y libres de regalías para la reproducción, distribución y creación de obras derivadas. La licencia exige a los redistribuidores conservar los avisos de copyright, pero ofrece el modelo «AS IS» sin garantía, según la documentación de licenciamiento de NVIDIA.

Los desarrolladores pueden acceder al modelo mediante AWS SDKs usando el identificador nvidia.nemotron-nano-3-30b. El modelo opera como un text-only language model optimizado para instruction-following, chatbots y flujos de trabajo ligeros concurrentes gestionados por AI agent clusters.

Sources

- aws.amazon.com/blogs/machine-learning

- nvidia.com